在數據產品的構建過程中,數據處理服務作為連接原始數據與最終業務價值的關鍵樞紐,其設計原則與架構實現直接決定了產品的性能、可靠性與擴展性。本文將深入探討數據處理服務的設計原則,并解析其核心架構的實現路徑。

一、數據處理服務的設計原則

1. 可擴展性原則

數據處理服務需具備水平擴展能力,以應對數據量激增或計算復雜度提升的場景。設計時應采用微服務架構,將數據處理任務拆分為獨立的、可復用的服務單元,通過容器化技術實現資源的彈性伸縮。

2. 可靠性原則

數據處理的準確性至關重要。服務需內置容錯機制,如數據校驗、異常重試與事務回滾,確保數據處理流程的最終一致性。通過多副本存儲與故障自動轉移,保障服務的高可用性。

3. 實時性與批處理平衡原則

根據業務需求,靈活支持實時流處理與離線批處理。實時處理適用于對時效性要求高的場景(如監控告警),而批處理則適合大規模歷史數據分析。架構上可通過Lambda或Kappa架構實現兩者的協同。

4. 數據血緣與可追溯性原則

數據處理服務應記錄完整的數據血緣信息,包括數據來源、轉換過程與輸出流向。這有助于問題排查、影響分析及合規審計,提升數據治理的透明度。

5. 安全性原則

在數據處理各環節實施加密、脫敏與訪問控制,防止數據泄露與篡改。尤其對于敏感數據,需遵循最小權限原則,并定期進行安全審計。

二、數據處理服務的架構實現

- 分層架構設計

- 接入層:負責數據采集與接入,支持多源異構數據(如數據庫日志、API接口、文件上傳)的實時同步。常用工具包括Apache Kafka、Flume等。

- 處理層:為核心計算層,根據業務邏輯進行數據清洗、轉換、聚合與建模。可選用Spark、Flink進行分布式計算,或使用Airflow、DolphinScheduler編排批處理任務。

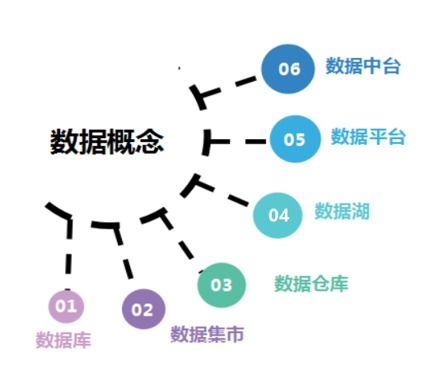

- 存儲層:提供分層存儲方案,如將熱數據存入HBase、Cassandra以供實時查詢,冷數據歸檔至HDFS或云存儲。利用數據湖技術實現原始數據與加工數據的統一管理。

- 服務層:通過API網關暴露數據處理能力,支持RESTful或gRPC接口,供下游應用調用。結合緩存機制(如Redis)提升高頻查詢性能。

- 關鍵組件與工具鏈

- 流處理引擎:Apache Flink憑借其低延遲、高吞吐的特性,成為實時處理的優選;對于復雜事件處理,可結合Esper或Spark Streaming。

- 批處理框架:Apache Spark的彈性分布式數據集(RDD)與結構化API,適用于大規模數據的迭代計算與機器學習任務。

- 任務調度器:Apache Airflow通過DAG(有向無環圖)定義任務依賴關系,實現可視化監控與自動化重試。

- 數據質量監控:集成Great Expectations或Deequ等工具,定義數據質量規則,實時檢測異常并告警。

3. 實踐案例:實時用戶行為分析管道

以電商場景為例,數據處理服務可構建如下管道:用戶點擊流數據經Kafka接入,由Flink實時過濾無效記錄、解析行為事件,并聚合為會話級指標;結果實時寫入ClickHouse供儀表盤展示,同時同步至HDFS留存原始日志。批處理任務每日凌晨啟動,通過Spark計算深度指標(如用戶留存率),并更新數據倉庫。整個流程通過數據血緣工具追蹤,確保端到端的可觀測性。

三、挑戰與演進方向

當前數據處理服務仍面臨挑戰:一是復雜業務邏輯下,流批一體架構的運維成本較高;二是數據隱私法規(如GDPR)對跨境數據處理提出更嚴要求。未來演進將聚焦于:

- 云原生與Serverless化:利用Kubernetes與函數計算(如AWS Lambda),進一步降低資源管理負擔。

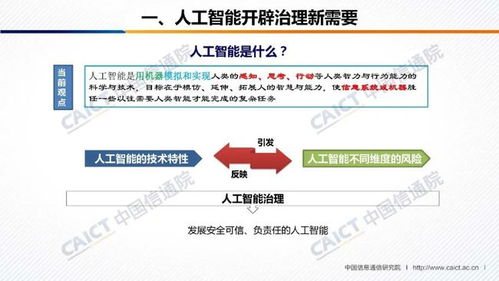

- AI增強的數據治理:引入機器學習自動識別數據模式、優化處理鏈路,并智能預警潛在風險。

- 邊緣計算集成:在物聯網等場景中,將部分處理任務下沉至邊緣節點,減少中心集群壓力并提升實時響應能力。

優秀的數據處理服務需以原則為綱,以架構為基,在動態平衡性能、成本與安全的過程中持續迭代。唯有如此,數據產品方能真正賦能業務,驅動智能決策。